Didžiausia internete veikusi „deepfake“ pornografijos svetainė uždaryta visam laikui

Didžiausia internete veikusi „deepfake“ pornografijos svetainė uždaryta visam laikui

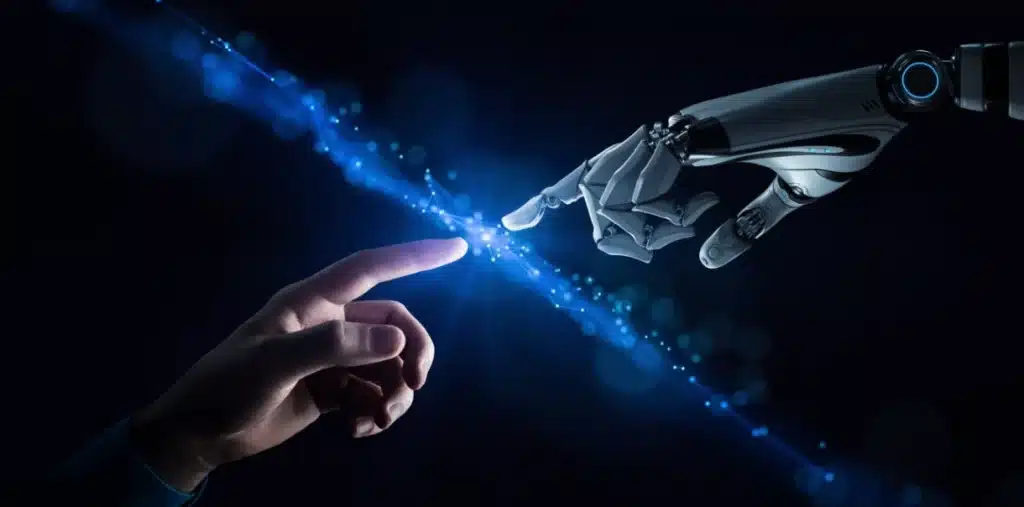

Plečiantis dirbtinio intelekto (DI) technologijoms vis labiau plinta vadinamieji „deepfake“ – DI pagalba manipuliuoti vaizdo įrašai, nuotraukos ar garso įrašai, kuriuose atrodo, kad realūs žmonės kalba ar daro tai, ko iš tiesų niekada nedarė. Ypač paplitusi tapo nelegali pornografinio pobūdžio medžiaga, kurioje naudojami realių žmonių atvaizdai be jų sutikimo. Tačiau viena didžiausių tokio pobūdžio svetainių ką tik buvo uždaryta.

Garsiai pagarsėjusi svetainė „MrDeepFakes“, kurioje be asmenų sutikimo buvo publikuojama tūkstančiai pornografinio pobūdžio „deepfake“ vaizdo įrašų, netikėtai nustojo veikti. Iki šiol svetainę kasdien lankydavo tūkstančiai vartotojų, tačiau šiuo metu jos tituliniame puslapyje skelbiama apie galutinį uždarymą, nurodant, jog svetainės veikla nutraukta dėl esminio paslaugų tiekėjo sprendimo nutraukti bendradarbiavimą.

Pranešime apie svetainės uždarymą teigiama:

„Pagrindinis paslaugų tiekėjas visam laikui nutraukė paslaugų teikimą. Dėl duomenų praradimo svetainės veiklos tęsti nebeįmanoma. Svetainė nebus paleista iš naujo, o bet kuri kita svetainė, kuri teigs priešingai, yra netikra. Domenas ilgainiui nustos galioti, už jo būsimą naudojimą neatsakome. Šis pranešimas bus pašalintas po savaitės.“

Kol kas tikslios priežastys, kodėl paslaugų teikėjas nutraukė bendradarbiavimą su „MrDeepFakes“, nėra atskleistos. Tačiau ekspertai spėja, kad sprendimas galėjo būti susijęs su nuolat didėjančiu spaudimu dėl svetainės vykdomos veiklos, kuria naudojami asmenų atvaizdai be jų leidimo, sukeliantys rimtas moralines ir teisines problemas.

„Deepfake“ keliamos problemos

Stanfordo ir Kalifornijos universiteto San Diege atlikto tyrimo duomenimis, net 98 % visų internete esančių „deepfake“ medžiagų yra seksualinio pobūdžio, dažnai siekiant pažeminti, persekioti, šantažuoti ar kontroliuoti aukas. Tyrimas taip pat atskleidė, kad 88 % šių manipuliacijų aukų yra moterys, dažnai žinomos aktorės ar muzikantės, nors „MrDeepFakes“ buvo skelbiama ir daugybė vaizdo įrašų su mažai žinomais ar viešai neaktyviais asmenimis, nors buvo teigiama, kad naudojami tik žinomų asmenų atvaizdai.

Tokių veiksmų aukos dažnai susiduria su rimtomis emocinėmis, psichologinėmis, reputacinėmis ir finansinėmis pasekmėmis, tačiau teisinis reguliavimas daugelyje šalių vis dar išlieka nepakankamas.

Be to, specialistai pažymi, kad šiuolaikiniai „deepfake“ vaizdo įrašai tapo taip techniškai pažangūs, kad net naujausi aptikimo įrankiai vis sunkiau nustato jų netikrumą. Ankstesnis požymis, pagal kurį buvo galima atpažinti netikrus vaizdo įrašus – širdies ritmo nebuvimas – dabar jau taip pat yra įtraukiamas į manipuliacijas, taip dar labiau apsunkinant jų atpažinimą.

Susijęs straipsnis: Išmaniosios klastotės arba „deepfakes“: ekspertė apie jų atpažinimo būdus ir įtaką mokiniams

Kaip vertinate šį straipsnį?

Prenumeruokite mūsų „YouTube“ kanalą ir mėgaukitės įdomiais vaizdo reportažais apie mokslą ir technologijas.

Trumpai, aiškiai ir be triukšmo – gaukite svarbiausias technologijų ir mokslo naujienas pirmieji.

DIENOS SKAITOMIAUSI

11 metų negalėjo pasiekti savo bitkoinų: viską pakeitė vienas bandymas su DI

2Kodėl žmonės sapnuoja košmarus: paaiškėjo, kokią funkciją jie gali atlikti

3Kvantinis kompiuteris parodė įspūdingas galimybes: užduotį išsprendė vos per 25 mikrosekundes

4Auginate „pinigų medį“? Mokslininkai jo lapuose aptiko netikėtą matematinę sistemą

5„ChatGPT“ atsakymas jaunuoliui kainavo gyvybę: nauja byla siunčia svarbų perspėjimą

NAUJAUSI

Taip pat skaitykite

Atrinkome panašius straipsnius, kurie gali jums patikti.