OpenAI darbuotojai ispeja kad dirbtinis intelektas gali sukelti zmonijos isnykima

„OpenAI“ darbuotojai įspėja, kad dirbtinis intelektas gali sukelti „žmonijos išnykimą“

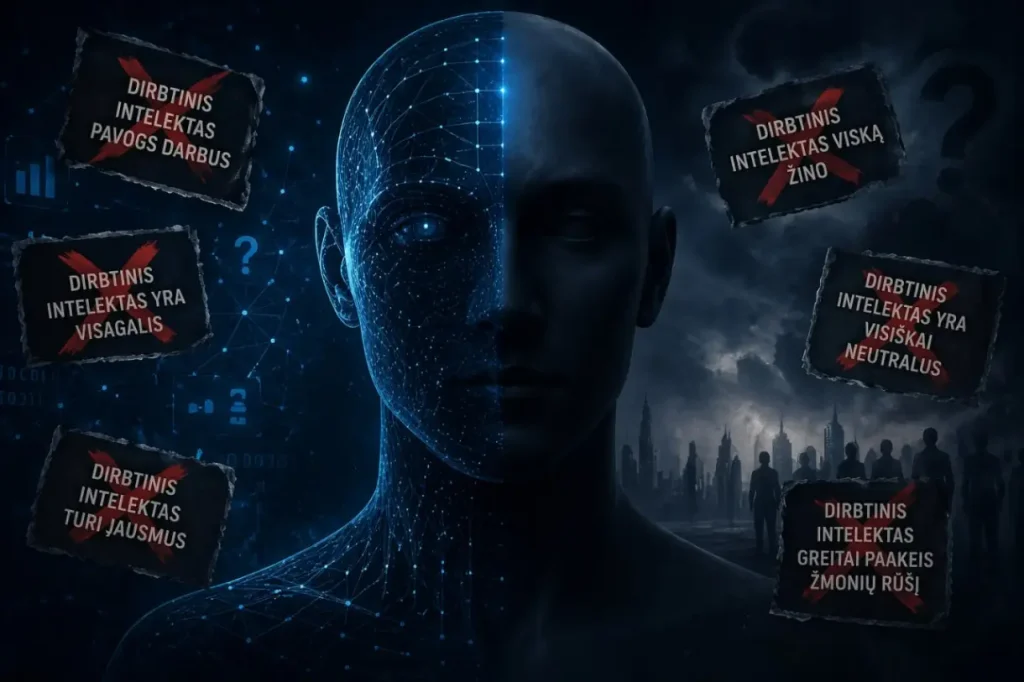

Grupė dabartinių ir buvusių svarbiausių Silicio slėnio įmonių, kuriančių dirbtinį intelektą, darbuotojų atvirame laiške įspėjo, kad be papildomų apsaugos priemonių dirbtinis intelektas gali kelti „žmonijos išnykimo“ grėsmę.

DI tyrėjams reikia daugiau apsaugos priemonių

Laiške, kurį pasirašė 13 daugiausia buvusių tokių įmonių kaip „OpenAI“, „Anthropic“ ir „Google“ „DeepMind“ darbuotojų, teigiama, kad geriausiems dirbtinio intelekto tyrėjams reikia daugiau apsaugos priemonių, kad jie galėtų išsakyti kritiką dėl naujų pasiekimų ir gauti visuomenės bei politikos formuotojų nuomonę dėl dirbtinio intelekto inovacijų krypties.

„Tikime, kad dirbtinio intelekto technologija gali suteikti žmonijai precedento neturinčią naudą“, – rašoma laiške. „Taip pat suprantame, kad šios technologijos kelia rimtą riziką. Ši rizika apima įvairias sritis – nuo tolesnio esamos nelygybės įtvirtinimo, manipuliacijų ir dezinformacijos iki autonominių dirbtinio intelekto sistemų kontrolės praradimo, galinčio lemti žmonių išnykimą.“

Laiške teigiama, kad įmonės, kuriančios galingas dirbtinio intelekto technologijas, įskaitant dirbtinį bendrąjį intelektą (DAB) – teoriškai tokią pat protingą arba protingesnę už žmogaus intelektą dirbtinio intelekto sistemą, „turi stiprių finansinių paskatų vengti veiksmingos priežiūros“ tiek iš savo darbuotojų, tiek iš visuomenės.

Neelis Nanda iš „DeepMind“ yra vienintelis dirbtinio intelekto tyrėjas, šiuo metu susijęs su viena iš laišką pasirašiusių kompanijų.

„Taip pasielgiau NE todėl, kad šiuo metu turiu ką nors, dėl ko norėčiau įspėti savo dabartinius ar buvusius darbdavius, arba konkrečiai kritikuoti jų požiūrį į informatorius“, – rašė jis „X“. „Tačiau manau, kad AGI turės neįtikėtinų pasekmių ir, kaip pripažįsta visos laboratorijos, gali kelti egzistencinę grėsmę. Bet kuri laboratorija, siekianti AGI, turi įrodyti, kad yra verta visuomenės pasitikėjimo, o darbuotojų patikima ir saugoma teisė pranešti apie pažeidimus yra pagrindinis pirmas žingsnis.“

Pranešime įmonės raginamos susilaikyti nuo dabartinių ar buvusių darbuotojų, kurie kalba apie dirbtinio intelekto keliamą riziką, baudimo ar nutildymo – tai greičiausiai nuoroda į šį mėnesį kilusį skandalą bendrovėje „OpenAI“, kur išvykstantiems darbuotojams buvo liepta rinktis, ar prarasti įgytas teises į akcijas, ar pasirašyti susitarimą dėl įmonės veiklos nekompromitavimo, kuris niekada nepasibaigė.

Vėliau „OpenAI“ atšaukė šį reikalavimą, sakydama: „Tai neatspindi mūsų vertybių ar įmonės, kuria norime būti.“

„OpenAI“ teigia, kad imasi visų reikiamų priemonių

„Mes didžiuojamės savo pasiekimais teikiant pajėgiausias ir saugiausias dirbtinio intelekto sistemas ir tikime savo moksliniu požiūriu į rizikos sprendimą“, – sakė „OpenAI“ atstovas spaudai. „Sutinkame, kad griežtos diskusijos yra labai svarbios, atsižvelgiant į šios technologijos svarbą, ir toliau bendradarbiausime su vyriausybėmis, pilietine visuomene ir kitomis bendruomenėmis visame pasaulyje.“

REKLAMA

Bendrovė pridūrė, kad imasi įvairių priemonių, siekdama užtikrinti, kad darbuotojai būtų išgirsti, o jos gaminiai būtų kuriami atsakingai, įskaitant anoniminę karštąją liniją darbuotojams ir Saugos ir saugumo komitetą, kuris tikrina bendrovės veiklą.

Be to, „OpenAI“ nurodė, kad remia didesnį dirbtinio intelekto reguliavimą ir savanoriškus įsipareigojimus, susijusius su dirbtinio intelekto sauga.

Atviras laiškas paskelbtas po to, kai didžiausios DI įmonės, ypač „OpenAI“, pradėjo nesutarimų sezoną, tuo pačiu metu, kai pristato DI asistentus ir pagalbininkus su naujomis galingomis galimybėmis, pavyzdžiui, gebėjimu gyvai kalbėtis su žmonėmis ir reaguoti į vaizdinę informaciją, pavyzdžiui, vaizdo įrašą ar parašytą matematikos uždavinį.

Aktorė Scarlett Johansson, kadaise filme „Ji“ įgarsinusi dirbtinio intelekto asistentę, apkaltino „OpenAI“, kad ši naudojo jos balsą kaip vieno iš savo produktų modelį, nors ji aiškiai atmetė tokį tariamą pasiūlymą. Nors „OpenAI“ generalinis direktorius, pristatydamas balso asistentą, „Twitter“ pavartojo žodį „jos“, vėliau bendrovė paneigė, kad Johansson balsą naudojo kaip modelį.

Be to, gegužę „OpenAI“, nepraėjus nė metams nuo jos įkūrimo, išformavo komandą, specialiai sudarytą ilgalaikiams dirbtinio intelekto keliamiems pavojams tirti.

Pastaraisiais mėnesiais iš įmonės pasitraukė daug geriausių tyrėjų, įskaitant vieną iš įkūrėjų Ilją Sutskeverį.

Tai naujausias sukrėtimas po to, kai praėjusiais metais įmonė patyrė didelį rezonansą sukėlusią kovą su valdyba, kurios metu Altmanas buvo laikinai nušalintas, o po mažiau nei savaitės vėl paskirtas į pareigas.

Kaip vertinate šį straipsnį?

Prenumeruokite mūsų „YouTube“ kanalą ir mėgaukitės įdomiais vaizdo reportažais apie mokslą ir technologijas.

Trumpai, aiškiai ir be triukšmo – gaukite svarbiausias technologijų ir mokslo naujienas pirmieji.

DIENOS SKAITOMIAUSI

3 ženklai, kurie išduoda apgaulingą el. laišką

2Mokslininkai paprašė DI sukurti biologinį ginklą – tai, ką gavo, sukėlė nerimą

3Pompėjoje DI atkūrė per Vezuvijaus katastrofą žuvusio vyro veidą: naujas požiūris į praeitį

4Visur jungiatės per „Google“ paskyrą? Štai kokie pavojai gali slypėti

5Eidamas 79-uosius metus mirė žmogaus DNR iššifruoti padėjęs J. Craigas Venteris

NAUJAUSI

Taip pat skaitykite

Atrinkome panašius straipsnius, kurie gali jums patikti.