Rusija platina netikrus vaizdo irasus vaizduojancius pasiduodancias Ukrainos pajegas

Rusija platina netikrus vaizdo įrašus, vaizduojančius pasiduodančias Ukrainos pajėgas

TRUMPAI

- • Rusija platina netikrus vaizdo įrašus apie Ukrainos karių pasidavimą.

- • Kad jie netikri - išduoda keletas konkrečių detalių.

- • Nepaisant to, dezinformacija mažina visuomenės pasitikėjimą ir kelia psichologinį spaudimą.

Šiandien „kova“ jau siejama ne tik su mūšio lauku, bet ir skaitmenine erdve, kurioje dirbtinis intelektas suteikia įspūdingas, bet tuo pačiu ir grėsmę keliančias galimybes, reikalaujančias pastabumo ir kritinio mąstymo. Rusijos karas Ukrainoje tai dar kartą įrodo – internete platinami vaizdo įrašai, kuriuose neva pasiduoda Ukrainos pajėgos, bet ar tai iš tiesų tikra?

Kuria savo tiesą

Nuo 2022 m. vasario vykstanti plataus masto Rusijos invazija į Ukrainą viso pasaulio dėmesį išlaiko dar iki šių dienų. Ir nors Rusija visada turėjo „savo“ karo priežasčių paaiškinimą, ji nori pakeisti ir pastarųjų įvykių, vykstančių fronto linijose, tiesą.

Keletą pastarųjų mėnesių, kai vis labiau kalbama apie galimą taikos planą, socialinių tinklų platformas užplūdo vaizdo įrašai, kuriuose matyti verkiantys, miniomis žygiuojantys, atsiprašinėjantys ar Ukrainos valdžiai priekaištus laidantys kariai. Dalis jų neva pasiduoda Donecko srityje, Pokrovske, kituose – 38-oji Ukrainos jūros pėstininkų brigada šalinasi iš Myrnohrado.

Štai, pavyzdžiui, vienas jų publikuotas socialiniame tinkle „X“. Žemiau pateiktame vaizdo įraše matyti, verkiančių Ukrainos karių minia.

Visi jie – netikri

Kitame vaizdo įraše matyti ir daugiau užfiksuotų akimirkų, kurios iš tiesų yra netikros. Ir tai patvirtina ne tik pačios karių brigados, teigiančios, kad niekada tokio pobūdžio įvykiuose nedalyvavo ar konkretūs kariai niekada su jais nebuvo, bet ir tam tikros detalės tuose vaizduose.

Kaip aukščiau vaizdo įraše skelbia „Kyiv Independent“, aiškiai matyti, kad tai šių dienų dezinformacijos kryptis, paremta dirbtinio intelekto galimybėmis. Tą gali išduoti veido mimikos netikslumai ir jos „dirbtinumas“, nenuoseklūs kūno judesiai ar tam tikros vizualinės anomalijos – neryškūs objektai ir atskiri jų elementai, kaip pavyzdžiui fantominės galūnės.

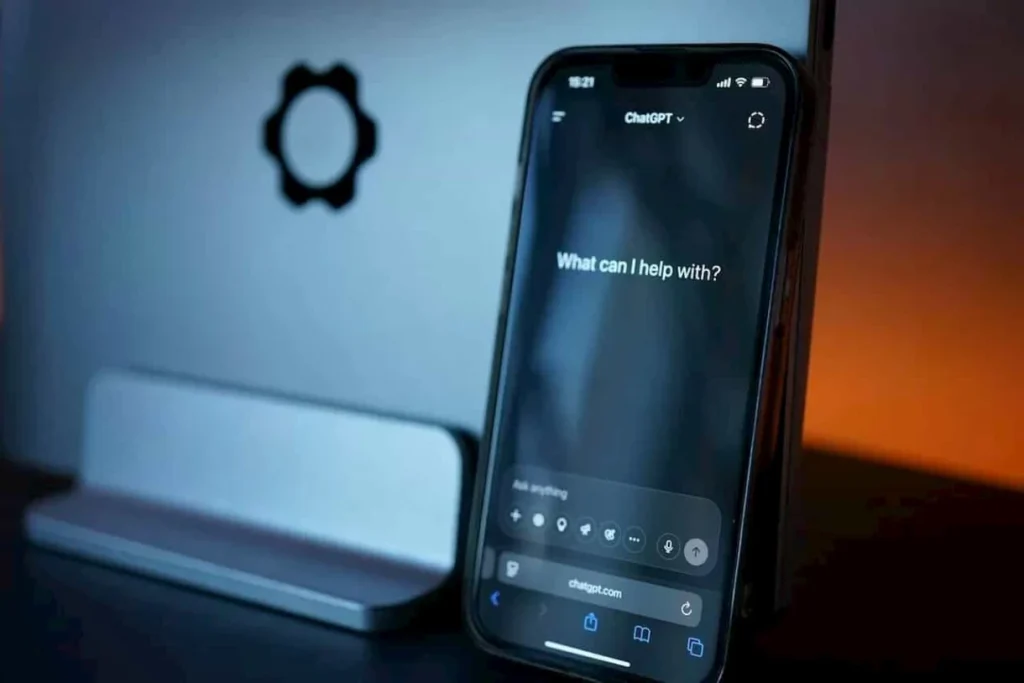

Visgi, netikrumą gali išduoti ir įrankių, skirtų vaizdų generavimui, logotipai. Anksčiau įkeltame „X“ įraše matyti, „OpenAI“ sukurto dirbtinio intelekto vaizdo įrašų generavimo „Sora“ logotipas, kuris yra pirminė indikacija, kad visa tai – netikra.

Tuo tarpu pats „Sora“ kelia dviprasmybę – demonstruodamas įspūdingas realaus gyvenimo atkūrimo galimybes, didina grėsmę informacijos skaidrumui.

Ne tik keisti, bet ir įbauginti

Ši Rusijos skleidžiama dezinformacija socialinių tinklų erdvėje be abejonės yra skirta keisti ir iškreipti visuomenės suvokimą apie vykstantį karą ir Ukrainos pasiryžimą atremti agresorę. O tą pasiekti labai lengva – daugelis vartotojų šių mažų detalių gali ir nepastebėti, o tą įrodo ir po tokiais įrašais esantys komentarai, kuriuose dalis vartotojų reiškia užuojautą ar peikia Ukrainos valdžią.

Kita vertus, Ukrainoje siekiama sukelti spaudimą, kurio metu neva karinės pajėgos silpsta, o tai ne tik skatina pasitikėjo savimi mažėjimą, bet ir kritiką Ukrainos vadovams.

Taigi, šiuolaikiniai karai vyksta ne tik mūšio lauke, bet ir informacinėje erdvėje. Joje svarbus budrumas, o kaip atpažinti dirbtiniu intelektu sugeneruotas nuotraukas rašėme šiame straipsnyje.

Kaip vertinate šį straipsnį?

Prenumeruokite mūsų „YouTube“ kanalą ir mėgaukitės įdomiais vaizdo reportažais apie mokslą ir technologijas.

Trumpai, aiškiai ir be triukšmo – gaukite svarbiausias technologijų ir mokslo naujienas pirmieji.

DIENOS SKAITOMIAUSI

Kiek kainuoja vienas bitkoinas? BTC kaina šiandien

2Lietuvos gyventojo tapatybę galima nusipirkti vos už 90 JAV dolerių

3Ypatinga žinia: Europoje aptiktas Jeloustouno dydžio „superugnikalnis“ – ką žinome

4DI vs. žmogus: kur dirbtinis intelektas jau lenkia mus

5Pirmą kartą viruso DNR perkeltas į kvantinį kompiuterį – prasideda naujas ligų tyrimų etapas

NAUJAUSI

Taip pat skaitykite

Atrinkome panašius straipsnius, kurie gali jums patikti.